(2018-02-08)每個人的背後都背著一具引擎,靠數學作動力,往往在關鍵時刻啟動,它能夠使我們的生活更趨完美,但同樣也能使生活愈為艱困。在AI與大數據趨勢下,數學引擎幾乎無所不在,就像一隻看不見的手。

(2018-02-08)每個人的背後都背著一具引擎,靠數學作動力,往往在關鍵時刻啟動,把我們的生活向前推進更趨完美,但也有太多的時刻引擎反轉,向後拉扯使我們的生活愈為艱困。這是AI與大數據下的經濟,也許我們感覺不到,但數學引擎確實存在,甚至無所不在,如果傳統經濟學有一隻看不見的手,現在這一隻、或是很多隻,是新的看不見的手。

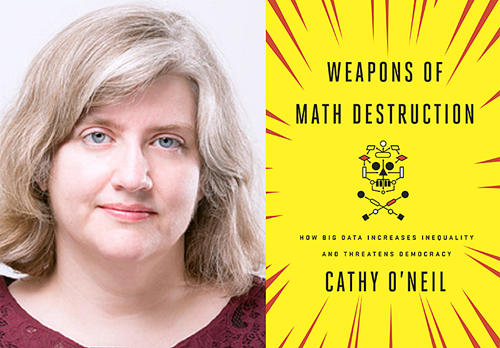

數學家Cathy O'Neil著作《Weapons of Math Destruction》。

紐約數學家Cathy O'Neil,從學校轉到華爾街,把課堂上的數目字轉到以億兆計的金錢,直到2008年華爾街崩盤,她看到了數學的威力,是數學把問題糾纏在一起,甚至是數學製造了更多問題。她寫了這一本書《Weapons of Math Destruction(數學毀滅武器)》,震驚了許多人,眾多媒體選為最佳著作,紐約時報評論說,作者讓我們驚嚇的看到,算術法(Algorithms)如何來掌控我們...。

算術法簡單的說是一種邏輯,是解決特定問題的規範,現在流行的AI,就是依照算術法寫成電腦程式。算術法是由一個數學模型推演出來的,而數學模型(Mathematical Model)是由數學家、統計學家制定的。如果在電腦運轉的AI出了問題,設計數學模型的人,無疑是始作俑者。

AI會出問題嗎?在我們漫不經心之下,有越來越多的AI進入了我的生活,我們許多在生活上的選擇,求學、謀事、借貸、醫保,都不是由人、而是由機器來決定的。理論上大家用同一尺度,摒棄人為的偏頗,是一個公平的法則,但背後所用的數學模型,既不受管制、又無法驗證,即使錯了也任其走下去。更甚者是不斷的擴大歧視,支撐幸運的人,卻懲罰不幸的人,數學就成了毀滅武器。

《美國新聞與世界報導》雜誌在1983年出版了「美國最好大學」排名,1987年以後每年出版至今,成為數以百萬學子升學的重要依據,誰不想進好學校?但怎麼知道是最好、或是好學校?排名背後的依據是什麼?

這本雜誌列出許多評比的項目,新生的會考成績(SAT)、新生第一年退學的比例、畢業人數的比例、教師與學生人數的比例、校友對母校捐助的金額等等,然後每一項目給予比重。這些項目一共占排名分數的75%,另25%是主觀的「聲譽」。

這個評比邏輯、或說是數學模型,並沒有什麼不好,直到擴大到全美多數大學。排名的不但影響申請入學的學生,更讓學校盡能事追逐排名,因為排名一旦落後,收不到好學生、聘請不到好教師、校友捐款也跟著減少,惡性循環,排名更落後。有的學校甚至造假,但聰明的學校就在無法量化的「聲譽」下功夫,花大錢成立球隊,比賽優勝名聲大噪,排名向前躍進一大步。

排名誘導所有的學校都一樣的運作,失去了排名以前每個學校的獨自風格與特色,而排名評比又不包括「學生學到了多少知識」這最重要的一項,那排名的意義與教育究竟有多少關連?評比也塑造了學生申請入學的模式,為了配合學校排名的需求,一種新的行業油然而生,就是代為申請入學,以高額費用來包裝申請人進入理想學校,但無力負擔包裝費用的,就可能被摒在校外了。

貧困的單身媽媽、最近離婚的、缺乏自信的、低薪工作的、身體或精神受過虐待的、最近被監禁的、毒品矯正的、工作沒有前途的,這些社會的邊緣人,卻同時出現在一所學校招生人員的手冊,成為招收的對象。這些學校並不在上述的評比之列,都是以職業與技術學院名義,廣招學生營利,招生成為市場促銷,網路加大數據,促銷越來越對象化。

這些學校花耗大筆經費在社群網路,從Google與臉書等大數據,設計數學模型尋找對象,對那些想得到文憑,學一技之長轉換工作,或是想自我提升信心的,都針對提出誘餌,協助學貸、介紹工作、改變人生。

學生自己僅出少額費用,就能獲得大筆政府貸款,但直到畢業發現高債無力償還,又學校用在招收新生的經費,往往數倍於用在教學的經費,導致學習品質低落,使得弱勢族群費盡心機得來的一紙文憑,在職場上敬陪末座。

一名優秀的大學生,因為憂鬱症休學一年半,痊癒之後轉學繼續學業,一個在超市工作的朋友正好離職,問他要不要做個兼差,他說願意就去應徵,手續很簡單,僅讓他回答一份問卷。但多日沒有回音,問他那位朋友怎麼回事,以他的資歷做最低時薪的超市工作,沒有不錄用的道理,但朋友告訴他考試(問卷回答)亮起「紅燈」,所以不被考慮。他把這件事告訴他父親,他父親讓他再試試別的地方,結果一連七家,都是紅燈。

他的父親是一名律師,覺得事情很有蹊蹺,問他兒子應徵問卷的內容。那是一份性向測驗,包括外向性、宜人性、自覺性、神經質、開放性等等,回答之後由一個電腦軟體評定後顯示綠燈、或是紅燈,而去應徵的這七家用的是同一個軟體,於是真相大白,這名應徵的學生患過憂鬱症,回答問卷必然是觸動了哪一個紅燈開關。這位律師寫信給這七家公司,聲稱要控告用問卷做求職依據的違法行為,幾年過去了,至今還個懸案。

上面不過是Cathy O'Neil書中許許多多例證的幾個,卻不難看出數學可以扮演邪惡的角色,這些決定命運的軟體或AI,既不透明、也不公開,從中獲利的人並不在意,而受害的又多是無能為力的弱勢族群。

靠機器決定,可以大幅度提昇效率,但損失了無法以量計的人性判斷,而人性判斷又往往是「公平」的重要元素。我們背後的數學引擎,提昇了效率,卻削弱了公平。

路透社說,這本書是矽谷不說的大數據故事。這本書的前言、以及封底,都用了這一句話結尾:歡迎來到大數據的黑暗面!Welcome to the dark side of Big Data!

*本文取材自2018年2月6日「那福忠西海岸數位隨筆(38)」:我們背後的數學引擎

對本文有任何看法,歡迎 E-Mail:frank.na@gmail.com 給作者,分享您對本文的看法。